Model Context Protocol (MCP) обеспечивает чистый, безопасный и гибкий способ интеграции искусственного интеллекта с реальным миром без необходимости каждый раз писать специальные коннекторы, пишет на портале The New Stack Росс Кукулински, вице-президент по управлению продуктами компании Kong.

За последний год большие языковые модели (LLM) превратились из исследовательских новинок в критически важные для бизнеса инструменты. Но интегрировать эти модели в производственные рабочие процессы, особенно когда речь идет об их использовании с API и внутренними системами, по-прежнему очень сложно. Большинство разработчиков все еще вручную соединяют хрупкие вызовы функций, сшивают код или полагаются на экспериментальные плагины. Не хватает последовательного, стандартизированного способа подключения LLM к инструментам, данным и инфраструктуре, на которых основаны современные приложения.

Именно здесь на помощь приходит MCP.

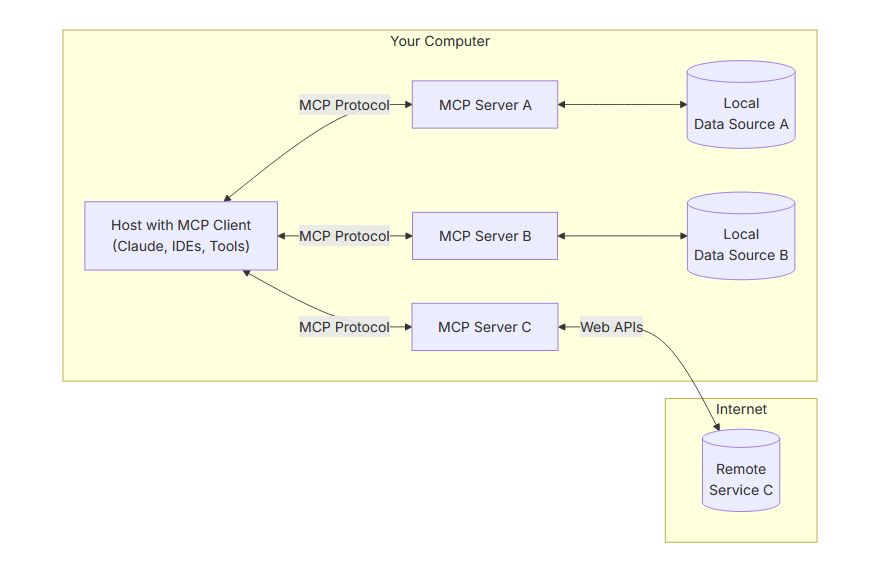

MCP — это легкий открытый протокол, предназначенный для стандартизации способов предоставления контекста приложениями агентам ИИ и LLM. Это своего рода «USB-C» для ИИ: универсальный способ подключения интеллектуальных агентов к сервисам и системам, которые им необходимы для понимания и взаимодействия. Независимо от того, подключаетесь ли вы к локальным источникам данных или удаленным API, MCP обеспечивает чистый, безопасный и гибкий способ интеграции ИИ с реальным миром без необходимости каждый раз писать коннекторы на заказ.

Давайте рассмотрим шесть причин, по которым MCP быстро становится необходимым для команд, работающих на стыке ИИ, API и инфраструктуры.

1. LLM не могут быть полезны, если они не видят ваш стек

LLM сильны в рассуждениях, обобщении и генерации, но они не могут взаимодействовать с системами, о существовании которых они не знают. Большинство корпоративных инфраструктур остаются невидимыми для агентов ИИ, пока кто-то явно не соединит точки, обычно через хрупкий одноразовый код или устаревшие определения API.

MCP представляет собой стандартную клиент-серверную модель, в которой агенты ИИ (или их среды разработки) обращаются к структурированным интерфейсам, известным как серверы MCP. Эти серверы предоставляют API, сервисы и даже данные плоскости управления через доступный для обнаружения, разрешенный интерфейс. Это означает, что ваши агенты могут видеть ваши внутренние инструменты, API и сервисы и рассуждать о них в контексте.

2. MCP привносит структуру в неструктурированную экосистему

Агенты ИИ работают лучше всего, когда они могут взаимодействовать с сервисами программно, но слишком часто эти сервисы недокументированы, непоследовательны или не содержат метаданных, необходимых для интеллектуального использования. Хотя такие стандарты, как OpenAPI, предлагают прочную основу для описания API, они, как правило, статичны и не обеспечивают полного семантического контекста или контекста среды выполнения, который необходим агентам ИИ «из коробки».

MCP опирается на эту основу, определяя, как сервисы должны описывать себя для ИИ — не только структуру, но и намерения. Это позволяет разработчикам указывать цель, параметры и результаты действий API таким образом, чтобы модели могли их понимать, запрашивать и действовать.

Это важный шаг от документирования к взаимодействию.

3. MCP обеспечивает рабочие процессы агентов в режиме реального времени

До появления MCP для большинства интеграций с

С MCP агенты поддерживают активные клиент-серверные соединения с сервисами, от которых они зависят. Это означает, что ИИ-помощник в вашей IDE или терминале может мгновенно запросить данные телеметрии, найти конфигурацию политики или вызвать микросервис без необходимости перекомпиляции или ручной перенастройки интеграций.

Такая связь в реальном времени открывает путь к созданию по-настоящему автономных агентов, которые могут отслеживать, реагировать и адаптироваться к живой инфраструктуре.

4. MCP обеспечивает гибкость без привязки к поставщику

Одно из самых недооцененных преимуществ MCP заключается в том, что по своей сути он не зависит от поставщиков ИИ. Таким образом, он не привязывает вас к конкретному поставщику LLM, цепочке инструментов ИИ или облачному провайдеру. В действительности MCP используется многими

Благодаря модульной архитектуре вы можете смешивать и сочетать системы ИИ и со временем менять поставщиков, не нарушая интеграции. Это особенно важно в современных условиях быстро меняющегося ландшафта ИИ, когда совместимость становится важнее, чем просто производительность.

5. MCP делает ИИ частью вашей модели управления

При открытии инфраструктуры для LLM возникает важный вопрос: как ее защитить?

С MCP доступ к данным больше не является побочным эффектом подключения инструмента; он является частью протокола. Каждый сервер MCP может определить, что именно он раскрывает и под какими учетными данными. Это означает, что агенты ИИ наследуют те же модели разрешений, которые вы уже используете в своих системах.

В результате вы можете предоставлять ИИ доступ с той же строгостью, что и пользователям-людям, и даже ограничивать его определенными службами, командами или средами развертывания. Это позволяет создавать безопасные, проверяемые рабочие процессы, в которых ИИ не становится помехой для соблюдения нормативных требований.

6. MCP готовит вас к ИИ-нативному опыту разработчиков

Будущее разработки ПО — это AI-native. IDE становятся «вторыми пилотами». Терминалы заменяются естественным языком. Разработчики уже обращаются к LLM с просьбой прописать (scaffold) код, отладить журналы и запустить сервисы.

MCP предоставляет этим средам недостающее звено: структурированный доступ в реальном времени к инфраструктуре, которой они должны управлять. Будь то обнаружение API, проверка шаблонов использования или инициирование развертывания, MCP делает инфраструктуру доступной для ИИ и, как следствие, для людей, которые ее используют.

Заключительные соображения

MCP — это не просто еще один слой в стеке, это новая соединительная ткань между ИИ и современными программными системами. Предоставляя последовательный, открытый и безопасный способ предоставления сервисов интеллектуальным агентам, MCP помогает раскрыть весь потенциал LLM в производстве.

И хотя команды могут создавать собственные MCP-серверы для предоставления API, данных о наблюдаемости или конфигураций политик, некоторые платформы уже предлагают поддержку MCP «из коробки», что позволяет начать работу и использовать его как никогда легко. Например, платформа управления жизненным циклом API, поддерживающая MCP, позволяет организациям предоставлять агентам ИИ всю систему отслеживания API, от обнаружения сервисов до аналитики трафика и настройки политик.

Эра AI-native быстро наступает. И MCP может стать тем стандартом, который обеспечит связь всего и всех.