Кто должен отвечать, если искусственный интеллект (ИИ) или робот совершат действие, причинившие людям вред?

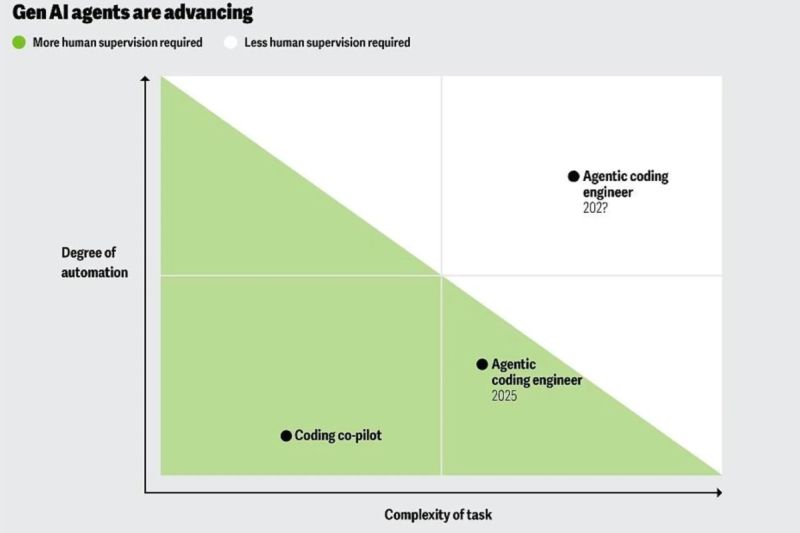

Это действие может быть случайным, но это один из многих встающих перед обществом вопросов об автономии и ответственности ИИ, когда его наиболее продвинутые формы, скажем, самоуправляемые автомобили (возможно, первые роботы, которым мы учимся доверять), дроны или даже средства ведения войны, получают все более широкое распространение.

Специалисты по ИИ и праву пытаются это понять, однако здесь нет простого ответа.

Один из экспертов, выступавших в Королевском обществе на заседании Британской академии по роботам и праву, высказал мысль, что ответ находится буквально у нас под носом. Ведь именно владельцы собак — а не те, кто их разводит и продает, — несут правовую ответственность за действия своего любимого животного, и то же самое можно приложить к роботам.

«У нас дома есть очень крупная собака; это итальянский мастиф весом в 65 кг, и, значит, она может быть очень опасной. Как владельцы этой собаки, мы несем за нее ответственность, и это важный принцип для робототехники: у каждого робота должен быть отвечающий за него человек», — сказал Патрик Хаггард, профессор когнитивной нейробиологии Университетского колледжа Лондона.

По его словам, ответственный владелец собаки будет всячески стараться, чтобы его собака находилась под контролем и состояла на учете, и то же самое должно применяться к роботам: «Собаку чипируют и регистрируют, чтобы ее можно было отслеживать, и, я думаю, это важный принцип в приложении к робототехнике: надо знать, кому принадлежат такие вещи».

Но допустим, чтобы избавиться от лишних хлопот, люди купили пылесос-робот и с ним что-то пошло не так. Разве в этом случае справедливо возлагать вину на его владельца? Разве это не ошибка изготовителя?

«В этой дифференциации нет смысла, — говорит по поводу разделения ответственности между пользователем и создателем ИИ Сюзанн Бек, профессор по уголовному праву и принципам юриспруденции Университета Ганновера. — Потому что идея иметь такие машины состоит в том, что мы не желаем нести ответственность за ошибки, которые они делают».

По ее словам, это значит, что вся концепция ответственности должна рассматриваться «совершенно другим образом», включающим переосмысление обязательств и ответственности, потому что «мы не можем просто сказать, что вышла ошибка, игнорируя ее последствия».

Ответ может содержать некий сорт электронной персонификации, что профессор Бек называет «прагматическим решением»: «Мы не должны рассматривать машину как индивидуум, но это реальная конструкция для юридических построений, и в этом суть дела. Не уверена, что это удовлетворит общество, но это стартовая точка».

Тем не менее, другие доказывают, что часть ответственности все же должна ложиться на разработчика. Потому что даже если ИИ не содержит непреднамеренных ошибок, его обучение после его выпуска в свет может пойти по неверному пути. Досадным примером является созданный Microsoft чатбот Tay, заразившийся расизмом после общения с пользователями Twitter.

Проблемы могут возникнуть и в обратной ситуации, если ИИ прошел обучение лишь на ограниченных объемах данных, как в случае, когда распознавание черт лица проходит тренировку на изображениях одной специфической группы людей.

«Хотя программирование может быть во всех смыслах идеальным, — говорит Роджер Бикерстаф, партнер международной юридической фирмы Bird & Bird, фокусирующейся на технологиях, — но если ПО обучается на предопределенных наборах данных, оно может выводить из них ошибочные заключения, либо может оказаться, что исходно закладывавшиеся данные были неправильными».

В любом случае вопрос остается юридически трудным. «Как разделить зоны ответственности программиста и владельца, учитывая, что роботы обучаются из окружающей их среды?», — спрашивает Хаггард.

Возможно, что в этой ситуации, беря за пример ответственность людей за своих собак, мы сделаем шаг в правильном направлении, по крайней мере, на сегодняшний день. Однако дискуссии об ИИ и ответственности за него будут продолжаться, так как машины становятся все умнее и играют все большую роль в нашей жизни.