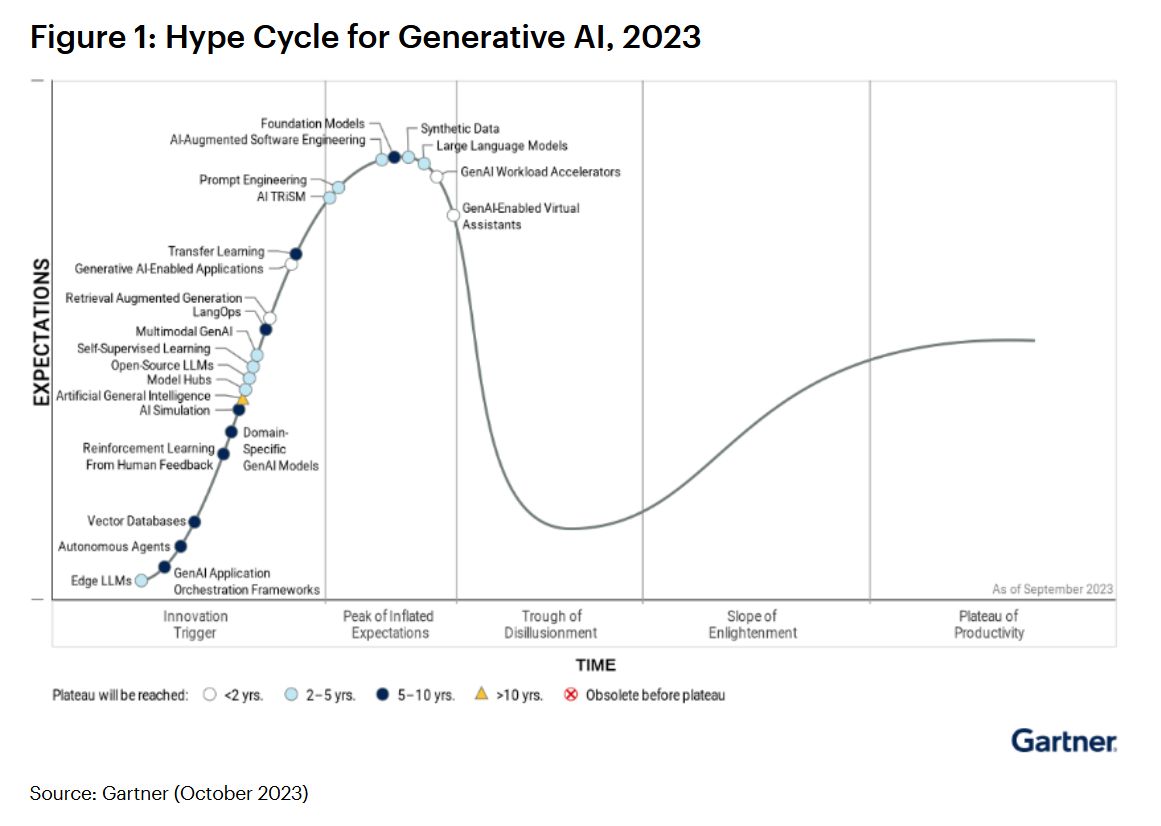

Думаете, что сейчас ИИ привлекает слишком много внимания? Как следует из нового отчета Gartner, в ближайшие два года это внимание еще больше усилится — особенно в корпоративном секторе, сообщает портал ZDNet.

С момента выхода ChatGPT почти год назад генеративный ИИ (GenAI) находится на подъеме, и компании ежедневно разрабатывают или внедряют модели ИИ. Новый отчет Gartner «2023 Hype Cycle for Generative AI» показывает, что в ближайшие годы этот рост будет только увеличиваться.

По прогнозам исследовательской компании, к 2026 г. 80% предприятий будут использовать API (интерфейсы прикладного программирования) и модели генеративного ИИ или разрабатывать свои собственные. Это означает, что всего за три года число предприятий, внедряющих или создающих GenAI-модели, вырастет в 16 раз, поскольку, по данным Gartner, в

«Генеративный ИИ стал одним из главных приоритетов для руководства компаний и вызвал огромные инновации в области новых инструментов, выходящих за рамки базовых моделей», — отмечает Арун Чандрасекаран, заслуженный вице-президент-аналитик Gartner.

Исследовательская компания выделила некоторые инновации, которые, по прогнозам, окажут огромное влияние на организации в ближайшие десять лет, включая приложения с поддержкой GenAI, базовые модели и управление доверием, рисками и безопасностью ИИ (AI trust, risk and security management, AI TRiSM).

Под приложениями с поддержкой GenAI понимаются приложения, использующие генеративный ИИ для решения конкретных задач. Примером может служить ChatGPT, использующий ИИ для синтеза текстовых запросов и выдачи ответа.

Организации могут использовать эти приложения, чтобы облегчить работу сотрудников внутри компании или предложить клиентам опыт, отличающийся повышенным качеством услуг и улучшенными впечатления клиентов.

«Наиболее распространенной моделью встроенных возможностей GenAI сегодня является технология text-to-X, которая демократизирует доступ работников к тем задачам, которые раньше были специализированными, посредством разработки запросов на естественном языке», — отметил Чандрасекаран.

Ярким свидетельством является растущее число консалтинговых компаний, которые внедряют или разрабатывают собственные ИИ-модели, чтобы облегчить клиентам поиск необходимых ресурсов в обширных базах данных компании.

Проблема таких приложений заключается в том, что они склонны к галлюцинациям и неточным ответам, что делает их надежность сомнительной.

Под базовыми моделями понимаются модели машинного обучения, которые лежат в основе приложений генеративного ИИ, например, как GPT в ChatGPT. Эти базовые модели обучаются на больших объемах данных и используются для работы различных приложений, способных решать самые разнообразные задачи.

Gartner поместила базовые модели на пик завышенных ожиданий в своем Hype Cycle, прогнозируя, что к 2027 г. они будут лежать в основе 60% приложений для обработки естественного языка (NLP).

«Технологическим руководителям следует начинать с моделей с высокой точностью из числа лидеров по производительности, моделей с превосходной экосистемной поддержкой и с адекватными корпоративными ограничениями в области безопасности и конфиденциальности», — говорит Чандрасекаран.

Наконец, под AI TRiSM понимается набор решений, способных решить проблемы, связанные с моделями GenAI, и обеспечить их успешное развертывание.

К числу рисков, которые подстерегают модели генеративного ИИ, относятся ненадежность, дезинформация, предвзятость, нарушение конфиденциальности и несправедливость. Если не принять должных мер, то эти вопросы могут быть особенно болезненными для организаций, поскольку они чреваты утечкой конфиденциальных данных и распространением дезинформации по всей организации.

«Организации, которые не управляют рисками, связанными с ИИ, экспоненциально склонны к неблагоприятным исходам, таким как провалы проектов и утечки информации, — отмечает Чандрасекаран. — Поэтому AI TRiSM крайне важен для организаций, чтобы минимизировать эти риски и защитить своих сотрудников».