Искусственный интеллект не только представляет собой угрозу, но и оказывается мощным союзником для служб безопасности. В этом году ожидается значительный рост влияния ИИ на кибербезопасность, пишет на портале Information Age Алекс Холланд, старший аналитик HP по вредоносному ПО.

Один из способов понять постоянно меняющуюся динамику соотношения сил атакующих и защитников — это анализ внешних факторов. При проведении такого анализа мы обычно сокращаем основные факторы до «PESTLE» — аббревиатуры, означающей политические, экономические, социальные, технологические, правовые и экологические аспекты. И, без сомнения, технологический фактор, который, по нашим наблюдениям, вызывает наибольшие изменения ландшафта угроз, — это стремительное развитие ИИ.

Киберпреступники все чаще используют ИИ для повышения эффективности и результативности своих атак. В то же время для защитников ИИ оказывается мощным союзником, улучшающим обнаружение и устранение угроз. Потребность в автоматизации задач безопасности с помощью ИИ также связана с большим дефицитом специалистов в сфере кибербезопасности.

Мы ожидаем, что в этом году влияние ИИ на кибербезопасность значительно возрастет. Он усовершенствует методы фишинга и ускорит обнаружение уязвимостей в системах. ИИ также ускорит разработку сетевых вторжений и реагирование на них. Чтобы опередить противников, которые уже начали внедрять ИИ, команды безопасности должны понимать не только угрозы, которые несет ИИ, но и возможности, которые он обещает улучшить.

В 2024 г. организациям следует сосредоточиться на трех областях, в которых ИИ способен изменить кибербезопасность:

#1. Атаки социальной инженерии с использованием ИИ

В 2024 г. ИИ увеличит масштаб и эффективность атак социальной инженерии, создавая очень убедительные фишинговые приманки всего за несколько мгновений. Киберпреступники будут использовать ИИ для создания персонализированных фишинговых сообщений, используя данные из социальных сетей и взломанных учетных записей электронной почты. Эти изощренные приманки будет сложно обнаружить даже подготовленным сотрудникам.

Более того, генеративный ИИ превратит киберпреступников в лучших мошенников. ИИ поможет злоумышленникам создавать хорошо написанные, убедительные фишинговые письма и веб-сайты на разных языках, что позволит им расширять сети своих кампаний в разных регионах. Мы ожидаем, что качество атак с использованием социальной инженерии повысится, а заманухи будет сложнее обнаружить как целевым группам, так и службам безопасности. В результате мы можем увидеть увеличение рисков и вреда, связанных с социальной инженерией, — от мошенничества до сетевых вторжений.

Мы также можем увидеть крупные фишинговые кампании с использованием ИИ, приуроченные к таким крупным событиям, как спортивные мероприятия (например, Олимпийские игры в Париже, футбольная Лига чемпионов) или шопинг (например, распродажи типа «Черная пятница»). Поскольку электронные письма, сгенерированные ИИ, становятся практически неотличимыми от легитимных, для защиты пользователей недостаточно полагаться только на обучение сотрудников. Вместо этого командам безопасности следует рассмотреть технологии изоляции, такие как микровиртуализация, которые не полагаются на обнаружение для защиты сотрудников. Эта технология открывает рискованные файлы и ссылки в изолированных виртуальных средах, предотвращая заражение устройств вредоносным ПО и программными эксплойтами — даже угрозами «нулевого дня».

#2. Локальные LLM

По мере роста вычислительной мощности новое поколение «ПК с ИИ» сможет запускать локальные большие языковые модели (LLM) без необходимости полагаться на мощные внешние серверы. Это позволит ПК и пользователям в полной мере воспользоваться преимуществами ИИ, изменив способы взаимодействия людей со своими устройствами.

Локальные LLM обещают повысить эффективность и производительность, а также обеспечить безопасность и конфиденциальность, работая независимо от Интернета. Однако локальные модели и обрабатываемые ими конфиденциальные данные, если их не защитить должным образом, могут превратить конечные точки в большую мишень для злоумышленников.

Более того, многие компании внедряют чат-боты, построенные на базе LLM, чтобы повысить уровень и масштабы обслуживания клиентов. Однако технология ИИ может создавать новые риски информационной безопасности и конфиденциальности, например, потенциально раскрывать конфиденциальные данные. В этом году мы можем увидеть, как киберпреступники попытаются манипулировать чат-ботами, чтобы обойти меры безопасности и получить доступ к конфиденциальной информации.

#3. Усовершенствованные атаки на встроенное ПО и аппаратное обеспечение

ИИ способствует демократизации технологий, помогая менее квалифицированным пользователям выполнять более сложные задачи более эффективно. Но хотя ИИ повышает защитные возможности организаций, он также может помочь злоумышленникам проводить атаки на нижние системные уровни, а именно на встроенное ПО и аппаратное обеспечение — в последние годы наблюдается рост числа таких атак.

Исторически такие атаки требовали обширных технических знаний, но ИИ начинает демонстрировать способность снижать эти барьеры. Это может привести к увеличению числа попыток злоумышленников использовать системы на нижнем уровне, чтобы закрепиться ниже операционной системы и лучших в отрасли программных средств защиты.

Со временем мы ожидаем увеличения числа вредоносных программ, нацеленных на прошивку системы, таких как MoonBounce и CosmicStrand. Эти атаки основаны на использовании слабых мест под операционной системой. Для противодействия этим угрозам необходимо сосредоточиться на закрытии зоны атак на аппаратное и микропрограммное обеспечение.

Новый рубеж для кибербезопасности

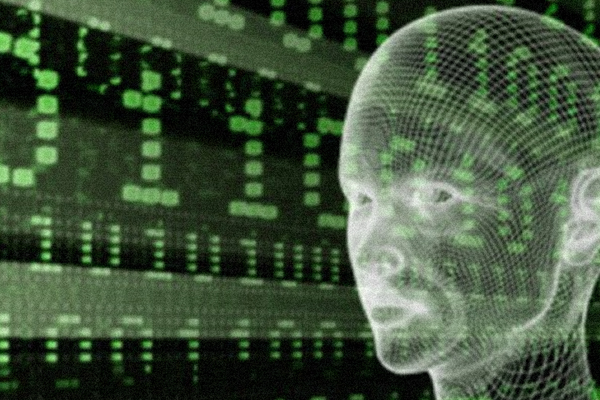

ИИ изменит систему кибербезопасности, открывая перед командами безопасности широкие возможности для улучшения обнаружения угроз и реагирования на них. Например, «вторые ИИ-пилоты» помогут защитить пользователей, автоматически обнаруживая целенаправленные попытки фишинга.

Появление ПК с ИИ также обеспечит преимущества безопасности, позволяя пользователям безопасно использовать ИИ на устройстве без риска раскрытия данных в облаке. Кроме того, эти устройства повысят уровень конфиденциальности данных благодаря таким функциям, как автоматическая блокировка и экраны конфиденциальности.

Однако для эффективного использования ИИ предприятия должны в первую очередь уделять внимание безопасности. Это означает знание своих данных и сред, моделирование угроз для понимания рисков, обеспечение баланса технологий предотвращения и обнаружения, а также внедрение принципов нулевого доверия для обеспечения безопасности данных. Наконец, организациям следует рассмотреть возможность сотрудничества с надежными поставщиками услуг по обеспечению безопасности ИИ, чтобы получить максимальную отдачу от ИИ и при этом минимизировать риски для безопасности и конфиденциальности.