Наступает осень искусственного интеллекта — сезон перемен, который откроет новую главу в развитии этих невероятных технологий, пишет на портале The New Stack Тони Белтрамелли, руководитель отдела ИИ-продуктов компании Miro.

Нет сомнений в том, что ИИ уже повсюду, и новые сценарии его использования появляются практически ежедневно, но за бесконечной шумихой скрывается гораздо более сложная реальность. Мы вступаем в парадокс ИИ: несмотря на то что ажиотаж вокруг этих новых технологий как никогда высок, большие языковые модели (LLM) достигли предела своих возможностей и демонстрируют лишь незначительные улучшения. Это вызвало споры среди специалистов в области ИИ о том, «бьются ли эти инструменты о стену» или эти опасения преувеличены. Ясно лишь то, что на данном этапе простое обучение LLM с использованием большего количества данных уже не приведет к прорывным улучшениям.

Итак, наступила ли зима ИИ? Пока нет. Напротив, мы вступаем в осень ИИ — сезон перемен, который откроет новую главу в развитии этих невероятных технологий. Хотя вероятность экспоненциальных улучшений с помощью LLM в направлении AGI (общего искусственного интеллекта) становится все менее вероятной (для AGI нам понадобится новая парадигма), я считаю, что гиперкастомизированные модели определят следующую эру инноваций в области ИИ. На этом этапе развития ИИ компании превратят LLM общего назначения в тонко оптимизированные модели, предназначенные для вертикальных сценариев использования и приложений.

Давайте посмотрим, как мы дошли до осени ИИ и что нас ждет впереди.

Причины замедления темпов совершенствования LLM

Производительность LLM была поразительной, и за последние несколько лет мы стали свидетелями одного из самых значительных технологических прорывов в истории. Тем не менее, существуют внутренние и практические ограничения, которые становятся все более очевидными по мере развития этой области:

- Масштабирование и сценарий убывающей отдачи. Хотя законы масштабирования (больше параметров модели и больше данных приводят к лучшей производительности) были верны в течение некоторого времени, отдача уменьшалась по мере роста моделей. Улучшения становились незначительными по сравнению с огромным ростом требований к вычислительным ресурсам и данным (стоимость), необходимым для обучения этих моделей.

- Больше данных не означает лучший ИИ. Современные LLM уже обучены на огромных наборах данных, включающих множество общедоступных и высококачественных данных. Учитывая масштабы лучших современных LLM, добавление дополнительных данных не обязательно означает добавление новых или ценных знаний — они могут просто повторять или усиливать то, что модель уже знает.

- Качество имеет значение. По мере того как лучшие источники данных исчерпываются, новые наборы данных, как правило, включают в себя менее качественные или более шумные данные. Это может снизить производительность модели или привести к чрезмерной подгонке, когда модель настолько точно отражает исходные обучающие данные, что не учитывает новые источники информации и выдает неточные ответы.

Кроме того, благодаря росту популярности LLM все больше компаний стали использовать их для создания онлайн-контента, а это значит, что новый интернет-контент теперь частично или полностью генерируется ИИ. Соответственно, обучение ИИ на контенте, созданном ИИ, не дает лучших результатов и может ухудшить работу моделей, что в конечном итоге приведет к их краху.

Доводы в пользу гиперкастомизированных моделей

Хотя LLM общего назначения являются отличной отправной точкой, им, как правило, не хватает глубокой экспертизы в конкретных областях. Во многом это похоже на ситуацию с человеческим опытом: человек не может стать экспертом в конкретной области, не имея формального образования, подготовки и глубокого опыта.

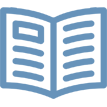

В будущем я ожидаю, что специализированные LLM будут все больше полагаться на тонкую настройку и адаптацию моделей общего назначения к конкретной области, и в процессе этого будет развиваться более специализированная экспертиза. Обучение на контролируемых высококачественных наборах данных из конкретной предметной области позволит этим моделям приобретать экспертизу без вычислительных затрат на обучение с нуля.

Компании будут разрабатывать решения на базе LLM, адаптированные к конкретным отраслям, с использованием терминологии, процессов и инструментов, относящихся к конкретной области. Эти модели будут оснащены оптимизированными пользовательскими интерфейсами и рабочими процессами — помимо распространенного интерфейса чата, с которым мы все знакомы сегодня.

Это также позволит компаниям создать настоящий «ров», или конкурентное преимущество на рынке, вокруг своих ИИ-продуктов. Воплотив свой собственный опыт и данные в узкоспециализированных моделях, они смогут опередить конкурентов и создать модели, которые другие не смогут легко воспроизвести.

Какие есть для этого основания? Посмотрите на появление DeepSeek — идеальный пример того, как небольшая, начинающая модель обучается с конкретной целью. Вскоре мы увидим «DeepSeek-подобные» ИИ, созданные для вертикальных задач, по мере того как совершенствование LLM будет замедляться, а специализированные модели будут доказывать свою состоятельность. Представьте, что вы используете ИИ типа ChatGPT, но он оптимизирован для очень специфической области, такой как дизайн UI/UX, архитектура, финансовое планирование, инфраструктура облачных вычислений и т. д. Эти небольшие специализированные модели будут дешевле обслуживать клиентов и работать прямо в наших веб-браузерах, мобильных телефонах и ноутбуках.

Осень ИИ: грядут изменения

Говорят, что перемены — единственная константа, и это, безусловно, относится к ИИ. За последние годы мы стали свидетелями огромных изменений, когда ИИ вошел в нашу повседневную жизнь и стал доминировать в новостях. Однако у каждого инструмента есть свои пределы, и мы начинаем отчетливо видеть, как они проявляются в LLM. Масштабирование этих моделей уже не может приносить прежнюю отдачу. Более того, поскольку многие из них уже были обучены на большинстве высококачественных наборов данных, обучение LLM на менее качественных или созданных ИИ данных приведет к созданию худших моделей и окажется непомерно дорогим.

Но это не значит, что наступит конец. Напротив, осень ИИ принесет новые захватывающие возможности для приоритизации гиперспециализации над генерализацией. Мы вступаем в новую эру экспертных моделей ИИ, и компании, которые воспользуются этим импульсом, получат огромные преимущества — и очень быстро.