Большие языковые модели (LLM, Large Language Models) трансформируют бизнес-процессы, автоматизируя работу с данными и взаимодействие с клиентами. В этом материале мы представим собственную оценку, какие LLM подходят для бизнеса и чем они отличаются.

В

По оценкам Gartner и McKinsey, рынок ИИ будет расти со среднегодовым темпом около 36% и к 2030 году может достичь 1,75 трлн. долл. При этом темп роста сегмента LLM и генеративного ИИ ожидается свыше 40%.

Тренды развития современных LLM

В последние месяцы рынок генеративного ИИ пережил значительный скачок в развитии: OpenAI выпустила новую модель ChatGPT o3-mini, а китайская компания DeepSeek представила DeepSeek R1, которая показала сопоставимые результаты при более низкой стоимости разработки. Alibaba выпустила модель Qwen 2.5 Max, заявив, что она превосходит по производительности модели от DeepSeek и OpenAI, а Илон Маск, стремясь конкурировать с OpenAI, основал компанию xAI, которая представила чат-бота Grok. Эти события вновь разогрели дискуссию о будущем LLM и их применении в бизнесе, а также привели к новой волне тестирований.

Рассмотрим основные тренды развития LLM.

1. Оптимизация вычислений для лучшего результата при меньших затратах

Ранее рост мощности LLM определялся увеличением количества параметров модели, что требовало значительных вычислительных ресурсов. Однако последние релизы показали, что эффективность можно повышать и без экстремального роста объема модели. Так, DeepSeek R1 продемонстрировала сопоставимую с GPT-4 производительность при значительно меньших затратах на обучение. В ответ OpenAI ускорила выпуск o3, а Google представила обновленную Gemini 2.0.

2. Расширение контекстного окна и глубины размышлений

Количество токенов, которые модель может учитывать в одном запросе, стало критически важным показателем. Если раньше стандарт составлял 128K, то теперь компании стремятся увеличить этот параметр для более сложных задач. Сегодня Google Gemini 2.0 Flash предлагает уже 1 млн. токенов, что позволяет моделям работать с большими объемами информации, включая анализ длинных документов, сложных кодов и диалогов.

Современные модели переходят от статичной генерации к гибкой системе размышлений. В OpenAI o3-mini, DeepSeek R1 и других передовых LLM появились уровни анализа запроса: быстрый режим (мгновенный ответ при минимальных вычислительных затратах), стандартный режим (баланс между скоростью и точностью) и глубокий режим (модель анализирует запрос пошагово, используя метод Chain-of-Thought), который позволяет находить более точные решения.

3. Фокус на безопасность и сложные технические задачи

Новейшая модель OpenAI o3-mini была протестирована на самых сложных бенчмарках, включая Humanities Last Exam, где она получила наибольший на сегодняшний день результат в 13% среди самых последних коммерческих моделей. Этот тест проверяет способность модели решать задачи, требующие глубокого понимания логики, аргументации и знаний в разных областях. Кроме того, OpenAI значительно улучшила защитные механизмы модели: перед генерацией ответа она анализирует запрос и пытается выявить попытки манипуляций и обмана. Модель способна отказать в ответе или предложить альтернативное объяснение, если пользователь задает вопросы на запрещенные темы.

Еще одно улучшение — интеграция с функциями поиска информации в Интернете, которая помогает повысить точность фактов. Модель формирует поисковый запрос, анализирует найденные источники и добавляет ссылки в ответы.

4. Развитие open-source LLM как альтернативы коммерческим моделям

Llama 3 от Meta (компания признана экстремистской и запрещена в РФ) и DeepSeek R1 уже доказывают, что open-source решения могут конкурировать с коммерческими LLM по качеству, при этом их можно адаптировать для корпоративных нужд.

5. Развитие мультиязычных возможностей

Хотя OpenAI и другие западные компании продолжают доминировать в сфере мультиязычных LLM, локальные модели набирают силу. Особенно это актуально для стран с ограниченным доступом к зарубежным решениям. Российские LLM, такие как YandexGPT, GigaChat и Cotype, активно дообучаются, хотя пока и уступают западным аналогам в ряде областей.

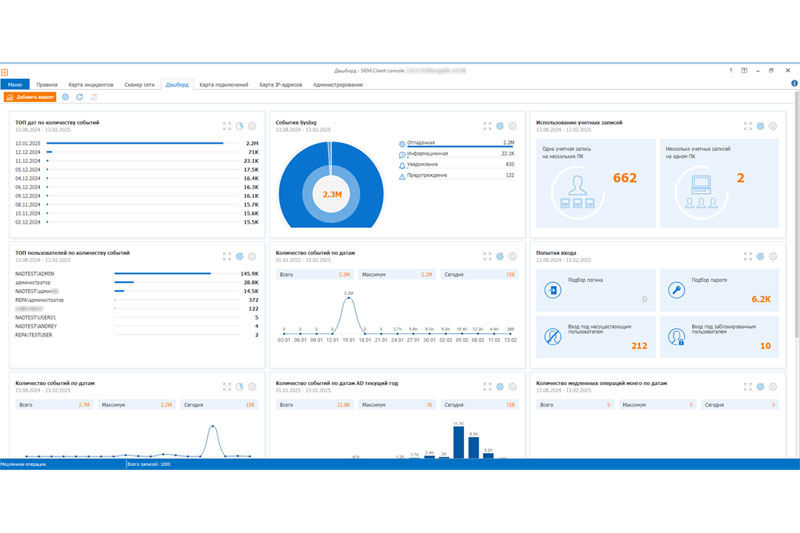

Как выбрать LLM для бизнеса

Компании, выбирающие LLM для внедрения, должны учитывать не только маркетинговые обещания, но и реальные показатели тестирования. Производительность на бенчмарках, глубина анализа, возможность контроля за выдаваемыми ответами, кастомизации и интеграции, стоимость использования и юридические ограничения — ключевые параметры, которые определяют, насколько эффективной будет интеграция ИИ в бизнес-процессы.

С развитием языковых моделей бизнес сталкивается с новым вызовом: использование мощных LLM в их общем виде не всегда эффективно. Создание собственных LLM дает бизнесу ряд преимуществ, связанных с безопасностью, точностью и экономической эффективностью. Компании получают полный контроль над данными, обучая модели на внутренних корпоративных источниках, что гарантирует соответствие отраслевым стандартам и требованиям безопасности. Кастомизированные модели значительно снижают вероятность генеративных ошибок и «галлюцинаций», так как адаптируются под узкоспециализированные задачи, а также легко интегрируются с корпоративными системами, включая CRM, ERP и базы знаний. В России такой подход также становится необходимостью из-за требований законодательства, накладывающего определенные ограничения на использование западных моделей.

Гибридный подход для бизнеса

Несмотря на растущий интерес к собственным моделям, гибридный подход к использованию LLM в бизнесе может быстро и существенно повысить эффективность работы при адекватных финансовых вложениях.

Гибридный подход, реализованный, например, в диалоговой платформе для разработки коммуникативного ИИ, сочетает в себе преимущества двух архитектур: в платформе создается четкая информационная база, которая служит основным источником фактов для модели. Генеративная модель берет на себя задачу ведения беседы, формулирования ответов и адаптации к стилю общения пользователя. При этом платформа задает четкие рамки, регулируя, на какие темы и в каком формате может отвечать LLM.

Очевидно, что рынок LLM вступает в фазу высокой технологической турбулентности, где ключевым фактором успеха станет не просто доступ к передовым моделям, а способность адаптировать их под конкретные бизнес- и социальные задачи, обеспечивая при этом надежность, управляемость и соответствие регуляторным требованиям.

Сравнение ключевых LLM

Ниже представлены ключевые особенности ведущих LLM и их отличия.

| Модель | Разработчик | Контекстное окно (максимальное количество токенов, которые модель может учитывать одновременно при обработке запроса) | Поддержка мульти-модальности | Основной фокус | Интеграция с поиском | Доступность в России |

|---|---|---|---|---|---|---|

| Claude | Anthropic (США) | 200K | Частично | Безопасность и интерпретируемость ответов. Контекстное окно до 200K токенов. Улучшенная работа с визуальными задачами. Высокая персонализация взаимодействия с пользователем. | Нет | Ограниченная |

| GPT-4/ChatGPT | OpenAI (США) | 128K | Да | Самая популярная коммерческая модель. Интеграция с GPT Search. Различные уровни «размышления» для более точных ответов. Универсальность и высокая генеративная способность. | GPT Search | Ограниченная |

| Gemini | Google (США) | 1M | Да | Контекстное окно до 1M токенов. Мультимодальная обработка текста, аудио, видео. Высокий уровень фактчекинга. | Нет | Ограниченная |

| YandexGPT | Yandex (Россия) | 100K | Нет | Локализация под российский рынок. Интеграция с отечественными сервисами. Соответствие российскому законодательству. | Нет | Полная |

| GigaChat | Сбер (Россия) | 200K | Нет | Поддержка корпоративных и банковских задач. Глубокая адаптация под локальные бизнес-процессы. Соответствие российскому законодательству. | Нет | Полная |

| Cotype | МТС (Россия) | 128K | Нет | Узкоспециализированные решения для бизнеса. Высокая скорость обработки запросов. Соответствие российскому законодательству. | Нет | Полная |

| Llama | Meta (США) | 128K | Нет | Открытый исходный код. Гибкость кастомизации. Развитая open-source экосистема. | Нет | Открытая |

| DeepSeek | DeepSeek (Китай) | 128K | Нет | Высокая эффективность при низких затратах. Поддержка open-source и обучения с подкреплением. Высокая производительность при сложных задачах. | Нет | Открытая |

| Qwen | Alibaba (Китай) | 200K | Да | Высокая производительность при конкурентной цене. Превосходит GPT-4o и другие ведущие модели по ряду параметров. Интеграция с облачной платформой Alibaba. | Нет | Открытая |